Symbolbild: Colourbox.

Argumentation ist allgegenwärtig, sei es in der Politik, auf dem Arbeitsmarkt oder im Privatleben. „Wir tauschen an allen möglichen Stellen Argumente aus“, sagt Prof. Dr. Annette Hautli-Janisz, Juniorprofessorin für Natural Language Processing an der Universität Passau. Beim Auftakt der Ringvorlesung zum Thema „Sprachmodelle – zwischen Hype und Realität“, die im Juni und Juli an der Universität Passau stattfindet, diskutierte sie mit Prof. Dr. Henning Wachsmuth vom Institut für Künstliche Intelligenz an der Universität Hannover die Frage, wie gut Sprachmodelle im Argumentieren sind - und wo die Grenzen liegen.

Beide Forschende kommen aus dem Bereich Natural Language Processing, der Verarbeitung natürlicher Sprache. Es handelt sich um ein Teilgebiet der künstlichen Intelligenz, das sich mit dem Verstehen und Erzeugen von Sprache durch Maschinen befasst.

Was Sprachmodelle können und was nicht – Einblicke in laufende Arbeiten

Wie sich Sprachmodelle zähmen lassen: Prof. Dr. Henning Wachsmuth und sein Team haben untersucht, ob Sprachmodelle in der Lage sind, beleidigende Aussagen zu entschärften, ohne den Inhalt zu verändern. Dazu ließen sie ein Modell und Menschen Kommentare überarbeiten, die sie im zweiten Schritt Menschen zur Bewertung vorlegten. Die maschinell erstellten Versionen wurden tatsächlich als gelungener eingestuft als die menschlichen Überarbeitungen. In einem weiteren Schritt testeten sie, wie weit das Sprachmodell jegliche argumentative Aufgaben lösen kann. Hier stieß das KI-Modell an Grenzen. Man müsse sich klarmachen, dass die Systeme nicht darauf ausgelegt seien, beim kritischen Denken zu unterstützen, sondern Anweisungen bestmöglich zu befolgen, so der Forscher.

Sprachmodelle als Imitatoren von Politikerinnen und Politikern: Ein Team um Prof. Dr. Hautli-Janisz und Steffen Herbold, Professor für AI-Engineering an der Universität Passau, wollte wissen: Können Sprachmodelle überzeugend in die Rolle von Politikerinnen und Politikern schlüpfen? Die Forschenden nutzten dazu einen Datensatz aus verschriftlichten Fragen und Antworten aus der britischen Politik-Talkshow BBC Question Time. Zusätzlich ließen sie ein Sprachmodell künstliche Antworten generieren und legten die Versionen britischen Bürgerinnen und Bürgern zur Bewertung vor. Die Befragten wussten zunächst nichts von dem Einsatz der Maschine. Ein Ergebnis: Die Teilnehmenden stuften die imitierten Antworten durchwegs als authentischer, schlüssiger und relevanter als die Statements der Politikerinnen und Politiker ein. „Generative Sprachmodelle sind so gut, dass sie Menschen nachweislich in die Irre führen können“, lautet ein Fazit von Prof. Dr. Hautli-Janisz. Die Studie ist als Vorabversion publiziert und befindet sich aktuell im Begutachtungsprozess.

KI als Bewährungsrichter in der Rechtsprechung: Ein Team um Prof. Dr. Hautli-Janisz untersuchte, wie sich Sprachmodelle als Bewährungsrichter machen. Der Grund: Im US-Staat Pennsylvania kommt künstliche Intelligenz als Unterstützung bei gerichtlichen Entscheidungen bereits zum Einsatz. Die Forschenden nutzten einen Datensatz mit Bewährungsanhörungen aus dem US-Staat Kalifornien, der im Internet öffentlich zugänglich ist. Sie anonymisierten die Anhörungsskripte und ließen das Sprachmodell auf deren Basis entscheiden. Das Ergebnis: „In 60 Prozent der Fälle repliziert das Modell die Entscheidung des Bewährungsrichters.“ In 20 Prozent aber entschied das Modell strikter und verweigerte die Bewährung. Die Forscherin betonte, dass hinter den Einsatz von KI in der Rechtsprechung ein großes ethisches Fragezeichen zu setzen sei. Die Studie ist noch nicht publiziert.

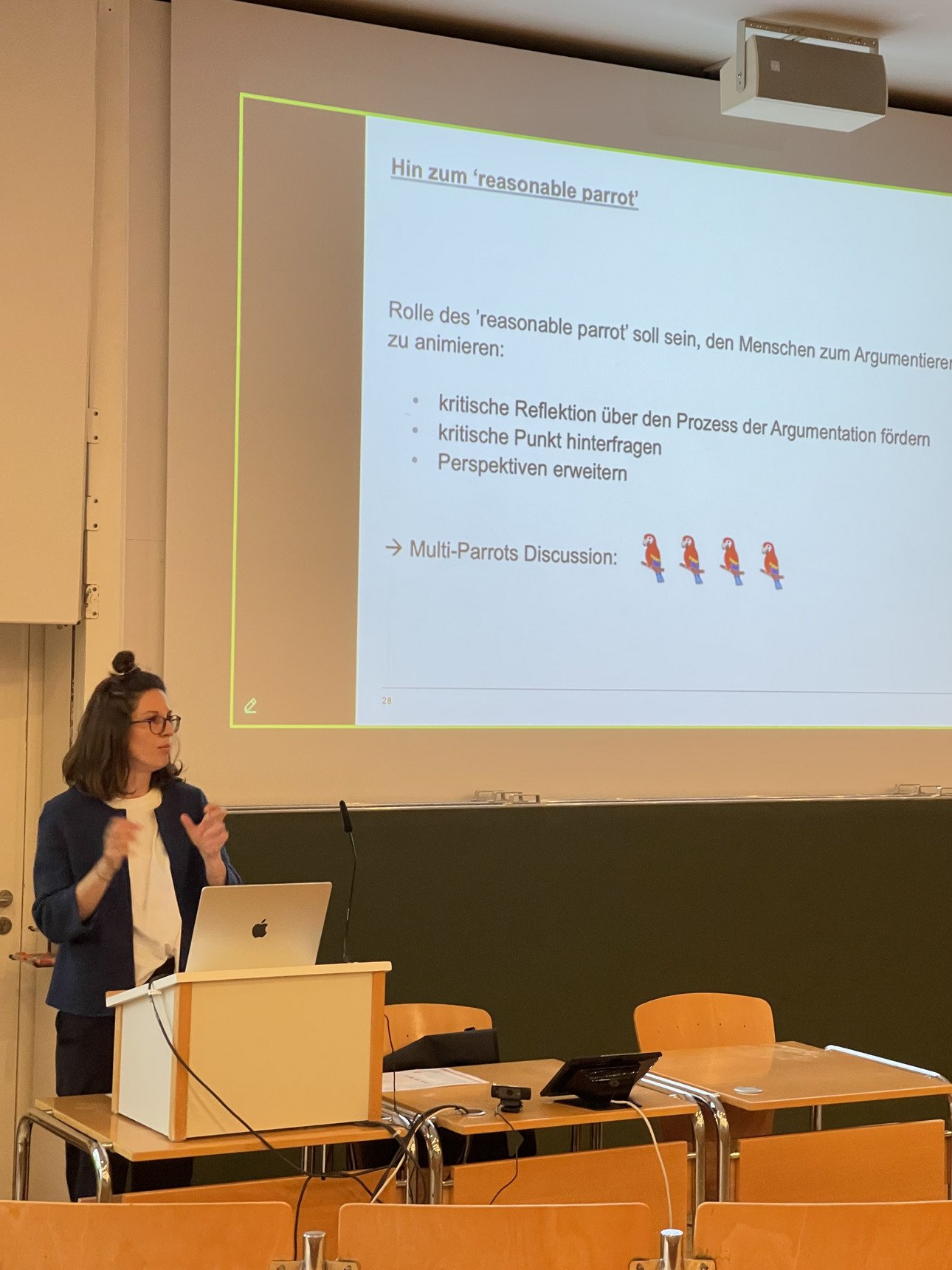

Idee – Sprachmodelle als vernünftige Papageien

Sprachmodelle können rhetorisch geschickt agieren, aber sie folgen dabei nur Anweisungen und regen nicht zum kritischen Denken an. Lässt sich das ändern? Ein interdisziplinäres Forschungsteam, an dem auch Prof. Dr. Hautli-Janisz und ihr Gast Prof. Dr. Wachsmuth beteiligt sind, hat eine Idee entwickelt – insbesondere mit Blick auf die Nutzung der Technik durch Kinder und Jugendliche. Die Forschenden versuchen, das Sprachmodell so zu trainieren, dass es in die Rolle philosophischer Papageien schlüpft und die jungen Nutzenden mit geschickten Nachfragen in eine Diskussion verwickeln. Der Ansatz könnte neue Wege für einen pädagogisch wertvollen Zugang zu der Technologie zu eröffnen.

Die Themen sind nur ein kleiner Auszug aus dem Forschungsfeld der Computerlinguistik. Wie groß dieses ist, zeigt ein Blick auf die Zahlen: Allein im Mai 2025 seien Prof. Dr. Hautli-Janisz zufolge 10900 Forschungspapiere mit dem Schlagwort ChatGPT veröffentlicht worden - und 27800 mit der Abkürzung LLM. Im Vergleich zum gleichen Zeitraum im Vorjahr bedeutet das nahezu eine Verdopplung bzw. eine Verdreifachung.

Fazit: Können Sprachmodelle argumentieren?

Sprachmodelle wirken zwar überzeugend. Doch die Technologie basiere auf dem „Momentum ad populum“, der Volksmeinung, erklärt Prof. Dr. Hautli-Janisz. Soll heißen: Was oft genug in den Trainingsdaten vorkommt, gilt dem Modell als plausibel – ein klassischer Fehlschluss: Eine Aussage wird dadurch begründet, dass eine Mehrheit sie glaubt. „Um Argumentation zu beherrschen, muss man sie nicht nur generieren können, sondern auch analysieren können“, sagt Prof. Dr. Hautli-Janisz. Das schafften Sprachmodelle für einzelne, spezifische Aufgaben. Doch generelle Aussagen über ihre Performanz sind immer noch schwierig.